Deepfake: il 2017, Reddit e l'inizio dell'era dei media sintetici

Nel dicembre 2017, un utente di Reddit pubblicò video manipolati che sovrapponevano volti di celebrità, scatenando un dibattito globale. Fu il debutto pubblico dei deepfake, che da allora confondono il confine tra realtà e finzione.

Deepfakes: il falsario e il detective

Nel dicembre 2017, un utente di Reddit di nome “deepfakes” ha pubblicato video inquietanti. Questi video sovrapponevano i volti di celebrità a quelli di attrici di film per adulti. L’effetto fu scioccante e, per l’epoca, sembrava reale. Questo segnò il debutto pubblico dei media sintetici e scatenò un dibattito globale sui video manipolati.

Queste creazioni, presto chiamate deepfake, rappresentarono un significativo progresso nell’intelligenza artificiale. Offuscarono il confine tra realtà genuina e fabbricata. La tecnologia sottostante non era del tutto nuova; si basava su decenni di ricerca nel machine learning. Tuttavia, la sua ampia disponibilità e l’elevata qualità visiva erano una novità.

In parole semplici, un deepfake utilizza l’AI per creare immagini, audio o video realistici. Sostituisce l’aspetto di una persona con quello di un’altra. Ciò spesso comporta lo scambio di volti o l’alterazione del parlato. L’obiettivo è far sì che il contenuto falso appaia autentico. Questa tecnologia è ormai comune e influenza tutto, dall’intrattenimento alle campagne di disinformazione.

I primi giorni: gli autoencoder e i primi scambi

I concetti iniziali per i deepfake iniziarono molto prima. I ricercatori esplorarono come le macchine potessero imparare dai dati. Uno sviluppo chiave avvenne nel 2006: il professor Geoffrey Hinton e il suo team all’Università di Toronto introdussero il deep learning. Questo metodo utilizzava reti neurali con molti strati e permise ai computer di elaborare schemi complessi.

Questo lavoro iniziale portò a uno strumento fondamentale per i deepfake: l’autoencoder. Un autoencoder è un tipo di rete neurale che impara a comprimere i dati e poi a ricostruirli. Immaginate un artista esperto che disegna un volto a memoria e poi lo ridisegna perfettamente. Questo processo ha due parti principali.

Innanzitutto, un encoder prende un’immagine in input, come un volto. Comprime questa immagine in una rappresentazione più piccola e astratta. Questo codice compresso cattura le caratteristiche chiave del volto. In secondo luogo, un decoder prende quel codice e cerca quindi di ricostruire il volto originale da esso. La rete si addestra confrontando la sua ricostruzione con l’originale e si adatta costantemente per ridurre gli errori.

Per creare un deepfake utilizzando gli autoencoder, vengono addestrati due autoencoder separati. Una rete impara dalle immagini del Soggetto A, l’altra impara dalle immagini del Soggetto B. Entrambe le reti utilizzano lo stesso encoder. Questo encoder condiviso impara a estrarre caratteristiche facciali comuni, concentrandosi su elementi come la posizione degli occhi o la forma della bocca. Questa conoscenza condivisa diventa una connessione cruciale.

Spesso chiamato il 'Padrino dell'AI', il professor Geoffrey Hinton è uno psicologo cognitivo e informatico britannico-canadese. Il suo lavoro pionieristico nel deep learning, in particolare con le reti neurali all'Università di Toronto nel 2006, ha gettato le basi cruciali per tecnologie come i deepfake. (Fonte: web.cs.toronto.edu)

Poi, per lo scambio di volti (face-swapping), l’encoder elabora un fotogramma video del Soggetto A ed estrae le caratteristiche facciali principali. Questo codice estratto passa poi nel decoder del Soggetto B. Il risultato è il volto del Soggetto B, ma con le espressioni e i movimenti della testa del Soggetto A. Questo metodo fu rivoluzionario. Tuttavia, spesso produceva difetti evidenti come sfarfallii o caratteristiche disallineate.

GAN: la rivoluzione avversariale

Un importante passo avanti nella creazione di immagini realistiche avvenne nel 2014. Ian Goodfellow, allora studente di dottorato all’Università di Montreal, propose le Generative Adversarial Networks, o GAN. Questo segnò un cambiamento significativo rispetto ai precedenti modelli generativi. Le GAN introdussero un nuovo metodo di addestramento, impostando una competizione tra due reti neurali.

Immaginate un falsario d’arte esperto e un astuto detective d’arte. Il falsario crea dipinti falsi, il detective cerca di identificarli. Entrambi migliorano a ogni tentativo. È esattamente così che funziona una GAN. Consiste di due reti neurali: un generatore e un discriminatore.

Il generatore agisce come il falsario. Il suo compito è creare dati sintetici. Per i deepfake, genera immagini o fotogrammi video realistici. All’inizio, produce rumore casuale. Nel tempo, impara a copiare immagini reali dal suo dataset di addestramento. Il suo obiettivo è ingannare il discriminatore facendogli credere che le sue creazioni siano reali.

Il discriminatore è il detective. Riceve due tipi di input: alcuni input sono immagini reali dai dati di addestramento, altri sono immagini false create dal generatore. Il suo compito è etichettare correttamente ogni immagine come “reale” o “falsa”. Il discriminatore fornisce feedback al generatore, dicendogli quanto è efficace.

Queste due reti si addestrano contemporaneamente in un processo competitivo. Il generatore cerca di migliorare i suoi falsi, il discriminatore cerca di migliorare la sua rilevazione. Questa competizione costante spinge entrambe le reti a migliorare. Alla fine, il generatore diventa bravo a creare immagini sintetiche credibili, che sono spesso difficili da distinguere da quelle reali. Questo addestramento avversariale ha reso i deepfake molto più realistici e sottili di quanto gli autoencoder potessero fare.

Ian Goodfellow, allora studente di dottorato all'Università di Montreal, propose le Generative Adversarial Networks (GAN) nel 2014. Questa architettura AI rivoluzionaria, che mette due reti neurali l'una contro l'altra, ha fatto progredire significativamente la creazione di immagini sintetiche realistiche e deepfake. (Fonte: deeplearning.ai)

Perfezionare il realismo: StyleGAN

Le prime GAN erano potenti, ma avevano ancora delle limitazioni. A volte faticavano a controllare caratteristiche specifiche dell’output generato. Ad esempio, era difficile cambiare l’acconciatura di una persona senza alterare anche il suo volto. Le loro creazioni potevano anche mancare di coerenza tra i fotogrammi video. Il realismo, sebbene migliorato, non era sempre perfetto.

Nel 2018, i ricercatori di NVIDIA introdussero StyleGAN. Questa architettura fece progredire notevolmente la tecnologia GAN. StyleGAN permise nuovi livelli di controllo sulla generazione di immagini, aggiungendo “stili” in diversi punti della rete. Immaginate di separare un dipinto nella sua composizione, colori e pennellate; StyleGAN permise un controllo stratificato simile.

StyleGAN aggiunse una “rete di mappatura” (mapping network) e uno strato di “normalizzazione adattiva dell’istanza” (AdaIN). La rete di mappatura trasforma un input casuale in uno spazio latente meglio organizzato. Ciò significa che diverse parti dello spazio controllano diverse caratteristiche visive. Gli strati AdaIN aggiungono poi questi “stili” nel generatore, influenzando tratti visivi specifici. Ad esempio, alcuni strati potrebbero controllare caratteristiche ampie come la posa o la forma generale del viso, mentre altri strati controllano dettagli fini, come la texture della pelle o il colore dei capelli.

Questo controllo stratificato permise ai ricercatori di creare immagini incredibilmente varie e di alta qualità. Potevano persino modificare attributi specifici senza influenzarne altri. StyleGAN di NVIDIA, e le sue versioni successive, produssero risultati quasi fotorealistici. Questo ampliò ciò che era possibile per i media sintetici, rendendo i deepfake ancora più difficili da distinguere dal contenuto reale. Il rapido aumento della potenza di calcolo e dei grandi dataset contribuì anche a questo progresso. I ricercatori potevano addestrare modelli più complessi su vaste quantità di dati, portando a risultati più intricati e convincenti.

La sfida del rilevamento: una corsa agli armamenti dell’AI

Man mano che la tecnologia deepfake migliorava, i metodi di rilevamento divennero cruciali. Ricercatori e organizzazioni riconobbero il suo potenziale di uso improprio. Questo diede inizio a una “corsa agli armamenti” nell’AI: i creatori di deepfake miravano a un realismo perfetto, mentre i rilevatori cercavano indizi sottili nei falsi.

I primi metodi di rilevamento si concentravano su difetti comuni. Questi includevano schemi di battito di ciglia incoerenti o movimenti insoliti della testa. Ad esempio, i soggetti dei deepfake spesso non battevano le ciglia naturalmente. Questo perché i dataset di addestramento di solito contenevano immagini con gli occhi aperti. I ricercatori dell’Università di Albany trovarono queste differenze e pubblicarono le loro scoperte in uno studio del 2019.

Il rilevamento più avanzato ora coinvolge la forensica AI. Questi sistemi cercano anomalie statistiche nei media generati. Analizzano minuscole incongruenze a livello di pixel ed esaminano anche leggere distorsioni nella geometria facciale. Esperti come il Dr. Hany Farid, professore all’UC Berkeley, sono specialisti di forensica digitale. Afferma che dobbiamo analizzare segni sottili, che includono illuminazione incoerente o ombre non corrispondenti. Tali dettagli sono difficili da riprodurre perfettamente per i modelli AI in un’intera scena.

Aziende come Google e Facebook hanno anche investito molto nel rilevamento dei deepfake. Hanno lanciato sfide per incoraggiare nuove soluzioni. Il DeepFake Detection Dataset di Google, rilasciato nel 2019, ha fornito un ampio dataset per i ricercatori, aiutando ad addestrare modelli per identificare video manipolati. La lotta continua mentre i creatori trovano nuovi modi per nascondere le loro tracce. I metodi di rilevamento devono cambiare costantemente per stare al passo. Questa lotta in corso mostra quanto possa essere fragile la fiducia digitale.

Il futuro della realtà sintetica

Il percorso dell’AI deepfake, dai primi autoencoder agli avanzati StyleGAN, continua. Le capacità della tecnologia crescono rapidamente. Ora va oltre i semplici scambi di volti. I ricercatori stanno sviluppando strumenti per la creazione di corpi interi e la copia realistica della voce. Questi progressi promettono grandi cambiamenti in molti settori.

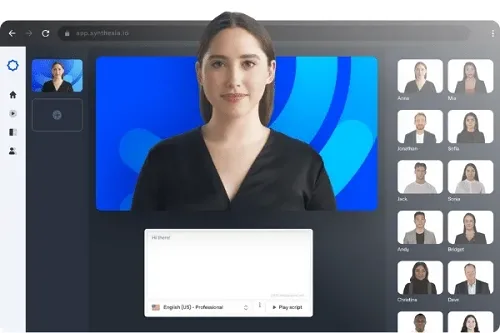

Nell’intrattenimento, i deepfake potrebbero cambiare il modo in cui vengono realizzati i film. Gli attori potrebbero essere ringiovaniti senza problemi. I personaggi digitali potrebbero eseguire acrobazie pericolose senza rischi. Aziende come Synthesia utilizzano già l’AI per creare avatar realistici per video di formazione aziendale, riducendo i costi e i tempi di produzione. Gli usi sono ampi e includono marketing personalizzato e persino assistenti virtuali.

Tuttavia, le preoccupazioni etiche rimangono significative. Il rischio di disinformazione, diffamazione e frode d’identità è enorme. Il Dr. Siwei Lyu, professore di informatica all’Università di Albany, avverte che ciò danneggia la fiducia sociale. Sottolinea la crescente difficoltà nel distinguere la verità dalle bugie. La facilità di creare falsità convincenti sfida l’alfabetizzazione mediatica tradizionale.

Governi e legislatori stanno lavorando per trovare modi per regolare questa tecnologia. Mirano a bilanciare l’innovazione con la sicurezza pubblica. Ciò include discussioni sulla filigrana digitale (digital watermarking) e il tracciamento dell’origine dei contenuti multimediali. Il futuro della realtà sintetica dipende da questo attento equilibrio, che ha bisogno sia di nuove tecnologie che di buone regole.

Synthesia è un'azienda che utilizza l'AI avanzata per creare avatar umani altamente realistici per video di formazione aziendale, marketing e altri contenuti digitali. Questi presentatori generati dall'AI dimostrano le applicazioni pratiche della tecnologia deepfake nella creazione della realtà sintetica. (Fonte: vidnoz.com)

Domande frequenti

Qual è la differenza principale tra un autoencoder e una GAN? Un autoencoder impara a comprimere e ricostruire dati utilizzando una rete. Una GAN utilizza due reti in competizione: un generatore che crea falsi e un discriminatore che li individua. Questo addestramento competitivo porta spesso a risultati più realistici.

Tutti i deepfake sono dannosi? No. Sebbene i deepfake siano diventati noti per usi negativi, hanno anche buone applicazioni. Queste includono la produzione cinematografica, le rievocazioni storiche e rendere i contenuti accessibili per le persone con disabilità. Lo scopo del loro utilizzo determina se sono etici.

Quanti dati sono necessari per creare un buon deepfake? La quantità di dati varia. I primi metodi deepfake richiedevano migliaia di immagini o ore di video. Le tecniche più recenti, specialmente con il transfer learning, possono creare falsi credibili con meno dati. Tuttavia, più dati di alta qualità generalmente portano a deepfake migliori e più coerenti.

Cosa significa “deep” in deepfake? Il “deep” si riferisce al deep learning. Questa è una parte del machine learning che utilizza reti neurali con molti strati. Queste reti sono spesso chiamate “reti neurali profonde” e aiutano l’AI a imparare schemi e caratteristiche complesse dai dati.

Potrebbe interessarti anche:

👉 Smascherare i bot online: la sfida di X e Facebook contro l’imitazione umana

👉 Prevedere le Tendenze del Mercato Azionario: Guida a ML e Analisi del Sentimento

👉 Metaverso: l’illusione di Zuckerberg – la tua libertà virtuale è un miraggio